你是否想过,有一天写论文、调模型、改代码不再需要熬夜盯屏幕?autoresearch 是由前特斯拉 AI 总监、OpenAI 创始成员、现 Stanford 研究员 Andrej Karpathy 发起的革命性开源项目——它把整个 LLM 训练流程交给 AI 代理自主运行:从修改训练脚本、启动单卡训练、评估指标变化,到自动保留最优方案,全程无需人工干预。它不追求超大规模算力,而是在一台消费级 GPU(如 RTX 4090)上,让 AI 像人类研究员一样“试错—学习—迭代”,真正实现「凌晨两点,你的模型在替你做实验」。

核心功能

- 全自动实验闭环:AI 代理读取 Markdown 格式的「研究计划」(

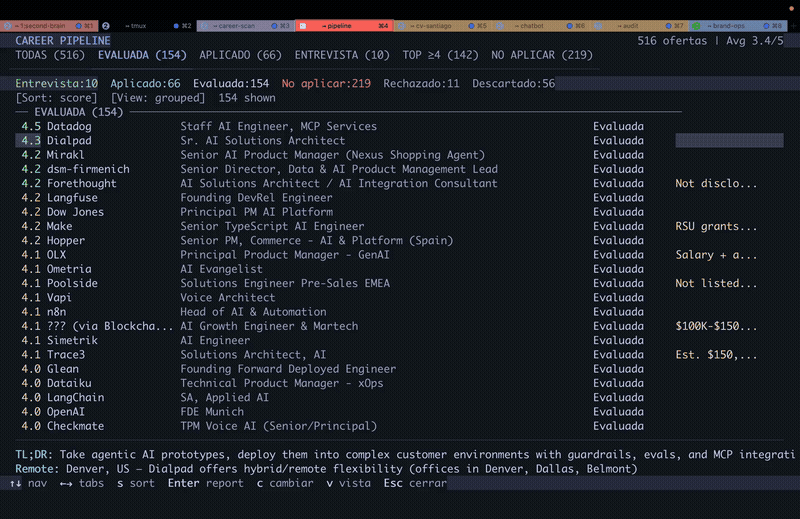

program.md),自主修改 Python 训练代码、启动 nanochat 风格的轻量 LLM 训练、运行 5 分钟快速验证,并基于 loss/accuracy 自动决策是否采纳变更 - 人机协作新范式:你不再直接编辑

train.py或model.py,而是用自然语言编写和迭代「研究指令」——比如“尝试将 dropout 从 0.1 提升到 0.3 并观察验证集困惑度变化” - 单 GPU 友好设计:基于 Karpathy 自研的 nanochat 极简训练框架,所有实验均可在一块显卡上完成,零门槛复现,学生党、个人开发者、小团队轻松上手

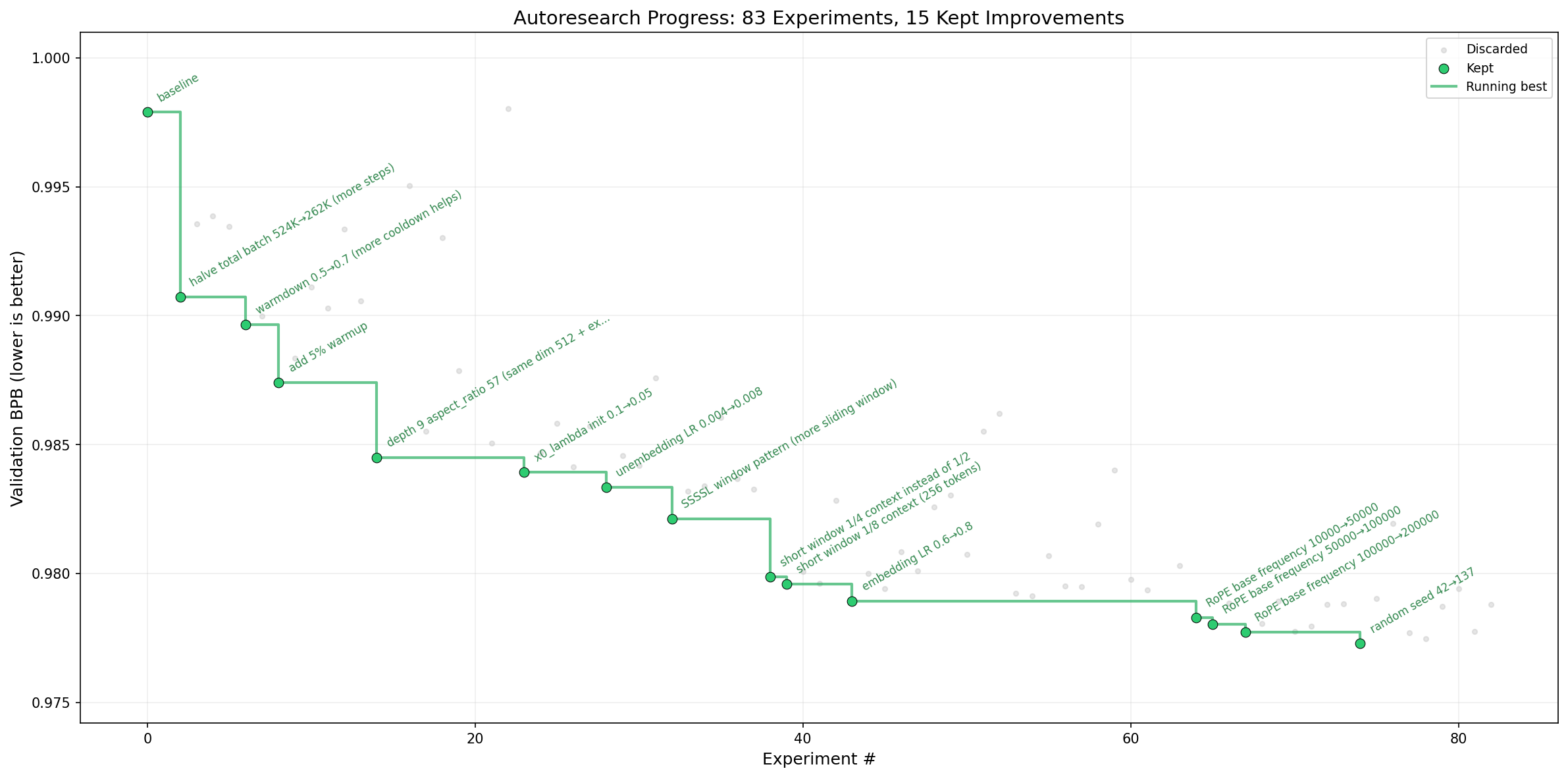

- 可追溯的实验日志:每次修改、每次训练、每次评估结果均自动生成结构化日志与可视化进度图(如 README 中的

progress.png),告别混乱的 terminal 复制粘贴 - 渐进式智能演进:支持多轮 agent 协作——例如一个 agent 负责提出假设,另一个负责编码实现,第三个负责评估分析,形成微型「AI 研究实验室」

- 开箱即用的基线模板:默认

program.md仅含最简指令,但清晰展示了如何定义目标、约束条件、评估标准和终止策略,是学习 AI 自主科研的最佳入门沙盒

适合哪些人用

如果你是高校研究生(尤其 NLP/LLM 方向),想快速验证训练技巧却苦于反复改代码;如果你是算法工程师,希望在上线前用低成本方式预筛超参组合;如果你是技术教育者,想带学生理解「AI 如何思考科研问题」;甚至如果你是好奇的技术爱好者,拥有一台带独显的笔记本——autoresearch 都是你接触下一代 AI 科研范式的最佳入口。它不替代深度思考,而是把重复劳动交给机器,把创造力还给人类。

快速上手

只需三步:

① 安装依赖:pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121(CUDA 12.1)+ pip install transformers datasets;

② 克隆项目:git clone https://github.com/karpathy/autoresearch && cd autoresearch;

③ 启动自动研究:python run.py(首次运行会自动下载 tiny llama-1b tokenizer 和 toy dataset)。你只需修改 program.md 中的自然语言指令,其余全部交给 AI 代理——睡一觉,早上查看 logs/ 目录下的实验报告即可。

项目信息

AI agents running research on single-GPU nanochat training automatically

64.5k

Stars

9.2k

Forks

Python

—

编程语言:Python|Star 数:64538|开源协议:未明确声明(建议使用前查阅仓库 LICENSE 文件)|GitHub 项目地址

这是开源界少有的、兼具思想高度与工程落地性的“未来科研操作系统”雏形——不是玩具,也不是 Demo,而是 Karpathy 用代码写给下一个十年的一封邀请函。