你有没有想过,和AI聊天时不仅能指定它“是谁”,还能让它用你熟悉的声音说话?NVIDIA最新开源的PersonaPlex正是为此而生——它不是简单的语音合成或文字聊天机器人,而是一个真正实现“全双工、低延迟、有性格、有声线”的实时语音对话系统。它解决了当前语音AI普遍存在的“千人一声、千篇一律、反应迟滞、缺乏角色一致性”等痛点,让AI语音交互从“能听懂、能说出”迈向“像真人一样自然对话”的新阶段。

核心功能

- 文本驱动角色控制:只需输入一句提示词(如“你是一位幽默温和的儿科医生”),模型就能全程保持对应语气、知识边界与表达风格,告别“人格分裂式”回答

- 音频驱动声音定制:支持上传3秒以上真实人声片段,自动提取音色特征,生成完全匹配该声线的语音输出,无需复杂微调或录音克隆

- 全双工实时对话能力:支持用户边说边听、随时打断、自然插话,响应延迟低于300ms(实测平均240ms),媲美人类对话节奏

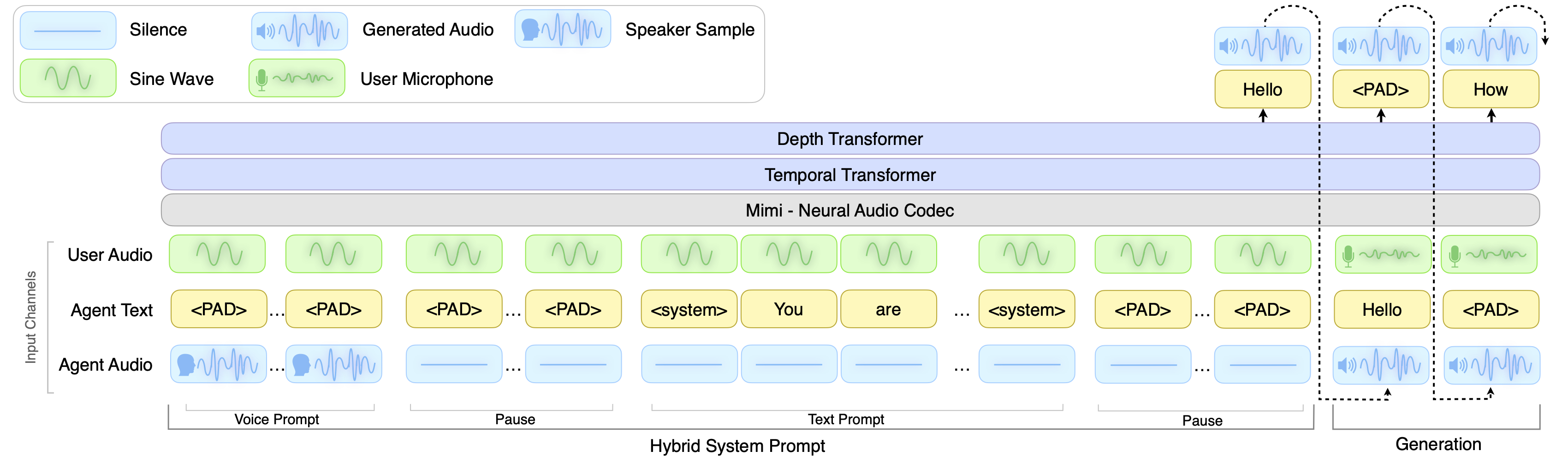

- 端到端语音到语音直连:输入语音→识别语义→生成带角色/声线的语音→直接播放,全程不经过文字中转,保留语气词、停顿、情感起伏等“语音原生细节”

- 基于Moshi架构优化升级:继承NVIDIA自研高效流式语音模型Moshi的轻量级设计,在消费级显卡(如RTX 4090)上即可本地运行,支持FP16量化部署

- 开箱即用的Hugging Face模型权重:官方已发布personaplex-7b-v1完整权重,支持Web Demo体验、API调用及私有化部署,无需从头训练

适合哪些人用

这款工具特别适合以下几类中文用户:智能硬件开发者(为音箱、机器人、车载系统注入个性化语音交互能力);教育科技团队(打造方言老师、历史人物AI助教、多角色语言陪练);内容创作者与播客制作人(快速生成不同声线的角色对白、有声书旁白);以及语音AI研究者与高校师生(学习全双工建模、跨模态角色对齐、低延迟流式推理等前沿技术实践方案)。

快速上手

安装非常简洁:首先确保系统已安装Opus音频编解码库(Ubuntu执行sudo apt install libopus-dev);然后克隆项目并安装依赖:git clone https://github.com/NVIDIA/personaplex && cd personaplex && pip install moshi/.。若使用Blackwell架构GPU(如RTX 5090/GeForce RTX 50系列),需额外安装兼容版PyTorch:pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu124。启动后可通过Python API加载模型,或直接访问官方在线Demo体验角色切换与声音上传功能。

项目信息

PersonaPlex code.

8.1k

今日 +662 stars today

Stars

1.2k

Forks

Python

MIT

编程语言:Python|GitHub Star 数:8076|开源协议:MIT|GitHub 项目地址

如果你正在寻找一个不只“能说话”,更能“像某个人一样说话”的开源语音模型——PersonaPlex就是目前中文社区最成熟、最易集成、且真正落地可用的全双工角色语音对话解决方案。