你是否曾在 M1/M2/M3 Mac 上尝试运行大语言模型,却遭遇内存不足、响应缓慢、后台无法常驻的困扰?oMLX 是一款专为 Apple Silicon 优化的轻量级 LLM 推理服务,它把强大的本地大模型能力浓缩进 macOS 菜单栏——无需命令行、不占桌面空间,点一下图标就能启动高性能推理服务,还支持 OpenAI 兼容 API,让你的 Mac 真正变成一台“私人 AI 服务器”。

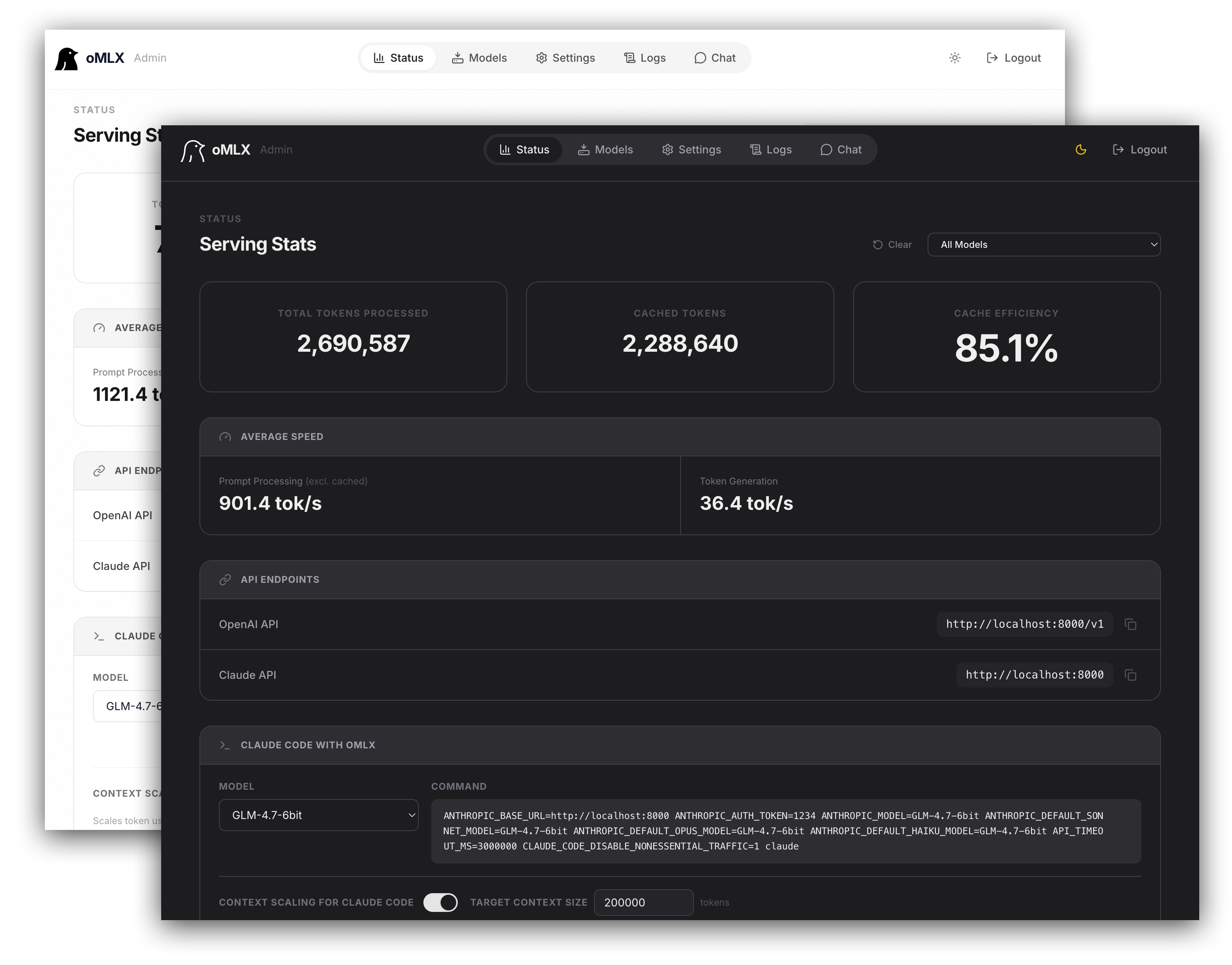

核心功能

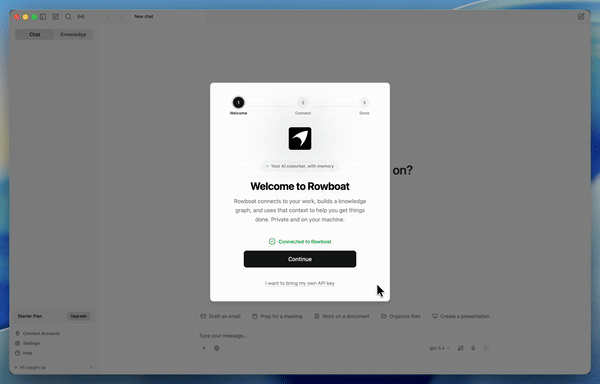

- 菜单栏极简管理:安装后直接在 macOS 顶部菜单栏显示图标,点击即可启动/暂停服务、切换模型、查看实时负载,小白用户零学习成本

- 连续批处理(Continuous Batching):自动合并多个用户请求,显著提升吞吐量,尤其适合多轮对话或批量 API 调用场景

- SSD 分层 KV 缓存:将大模型推理中占用内存最多的键值(KV)缓存智能落盘至 SSD,在有限内存下支撑更大上下文(如 32K+ tokens),告别频繁重计算

- 原生 Apple Silicon 加速:深度基于 MLX 框架构建,充分利用 GPU(Apple Neural Engine + Metal)与统一内存架构,推理速度比纯 CPU 方案快 3–5 倍

- OpenAI 兼容 API:启动即提供标准

/v1/chat/completions等接口,可无缝对接 Cursor、Ollama WebUI、LangChain、LlamaIndex 等生态工具 - 静默后台运行:无窗口、无 Dock 图标,仅驻留菜单栏,不干扰工作流;支持开机自启与系统休眠唤醒后自动恢复服务

适合哪些人用

如果你是以下任一角色,oMLX 就是为你量身打造的工具:

- 开发者与工程师:需要在本地快速验证 LLM 应用逻辑、调试 RAG 流程、或搭建私有 AI 微服务,又不想折腾 Docker 或远程服务器

- 产品经理与设计师:想随时与本地模型对话获取创意灵感、润色文案、生成原型提示词,但对终端命令和环境配置望而却步

- 科研与教育工作者:需离线运行敏感数据(如论文草稿、学生作业、内部文档),确保隐私不出设备,同时获得接近云端的响应体验

- Apple 生态重度用户:手握 M 系列 Mac 却长期闲置其强大算力,希望用最“Mac”的方式——简洁、安静、可靠——释放本地 AI 潜能

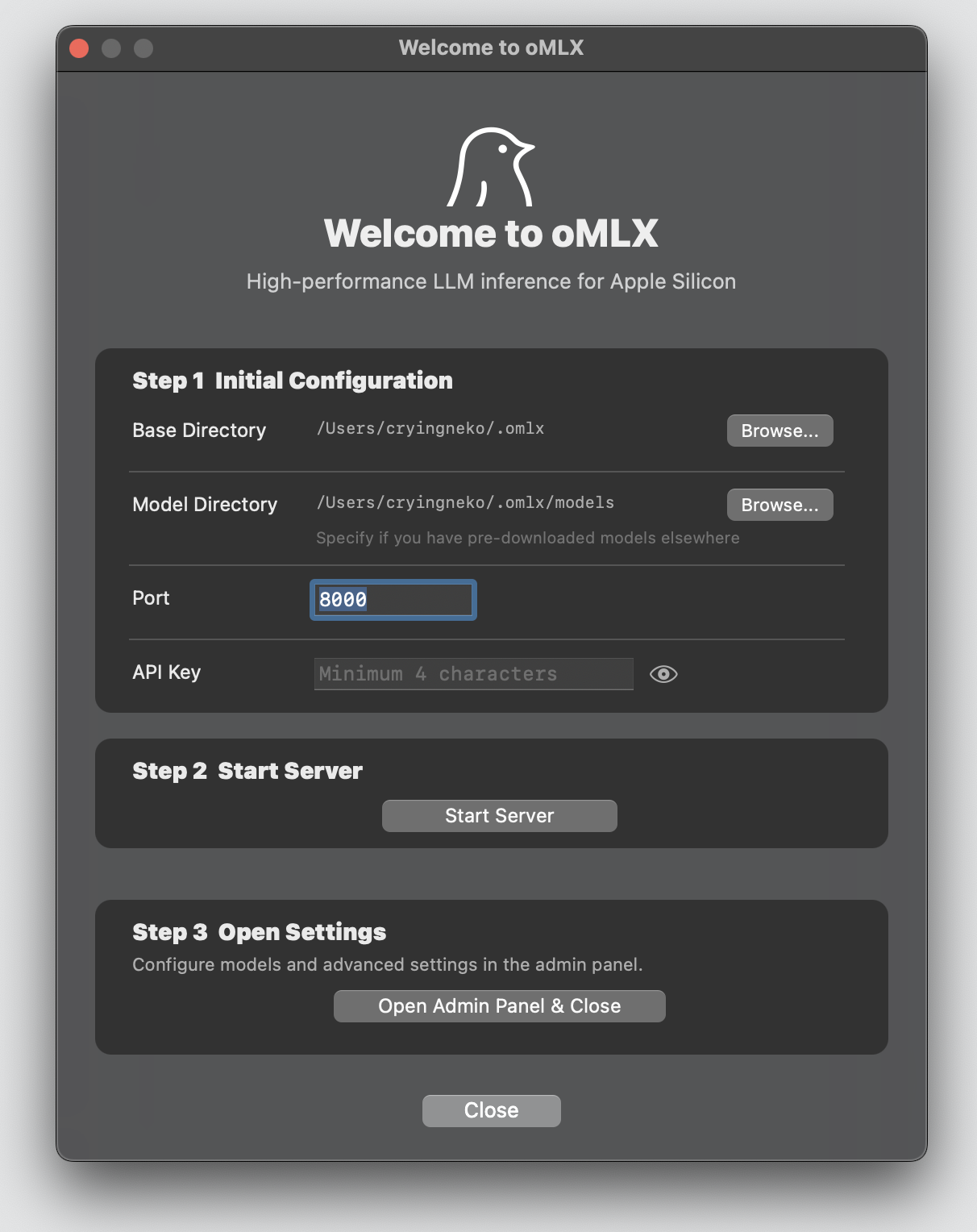

快速上手

只需三步,60 秒内完成部署:

- 安装依赖:确保已安装 Python 3.10+(推荐通过 Homebrew 安装)和最新版 Xcode Command Line Tools

- 一键安装:打开终端,执行:

pip install omlx - 启动服务:运行

omlx start,菜单栏即出现 oMLX 图标 → 点击「Start Server」→ 自动下载默认模型(Phi-3-mini 或 Qwen2-1.5B)并启动 API 服务

默认地址为http://localhost:8080,可用curl或任何 OpenAI SDK 测试:curl -X POST http://localhost:8080/v1/chat/completions -H "Content-Type: application/json" -d '{"model":"phi-3-mini","messages":[{"role":"user","content":"你好"}]}'

更多模型选择、GPU 内存分配、上下文长度等配置,可通过菜单栏「Preferences」图形化设置,或使用 omlx config 命令行调整。

项目信息

LLM inference server with continuous batching & SSD caching for Apple Silicon — managed from the macOS menu bar

13.1k

今日 +187 stars today

Stars

1.1k

Forks

Python

Apache-2.0

编程语言:Python|GitHub Star 数:13,078|开源协议:Apache-2.0|GitHub 项目地址

这不是一个“又一个 LLM 工具”,而是真正理解 Mac 用户痛点的诚意之作——它把前沿的连续批处理与 SSD 缓存技术,封装成 macOS 原生体验,让顶级 AI 能力回归桌面,安静、高效、触手可及。