Claw Code 是一个开源的、高性能的命令行智能代理(CLI Agent)运行时框架,专为在本地高效调度和编排大语言模型(LLM)、工具函数与工作流而设计。它不是某个具体 AI 应用,而是你所有 AI 工具背后的“操作系统内核”——帮你把模型调用、上下文管理、插件扩展、会话持久化等复杂逻辑全部封装成简洁、可靠、可组合的 CLI 命令。当你厌倦了反复写 curl 请求、拼接 prompt、手动管理 API Key 和会话状态时,Claw Code 就是那个让你重获开发自由的底层引擎。

核心功能

- 毫秒级 CLI 代理启动:基于 Rust 构建,二进制体积小、内存占用低、冷启动快至 30ms 内,真正实现“敲完回车即响应”

- 多模型统一抽象层:原生支持 Ollama、Llama.cpp、OpenAI 兼容接口、Claude、Gemini 等主流后端,无需修改代码即可切换推理引擎

- 声明式工具链编排:通过 YAML/JSON 定义工具函数(Tool Calling),自动解析 LLM 输出并安全执行本地命令、HTTP 请求或 Python 脚本

- 会话感知的上下文管理:内置持久化会话存储(SQLite + 可选加密),支持跨终端恢复对话历史、记忆用户偏好与项目上下文

- 开箱即用的健康诊断系统:运行

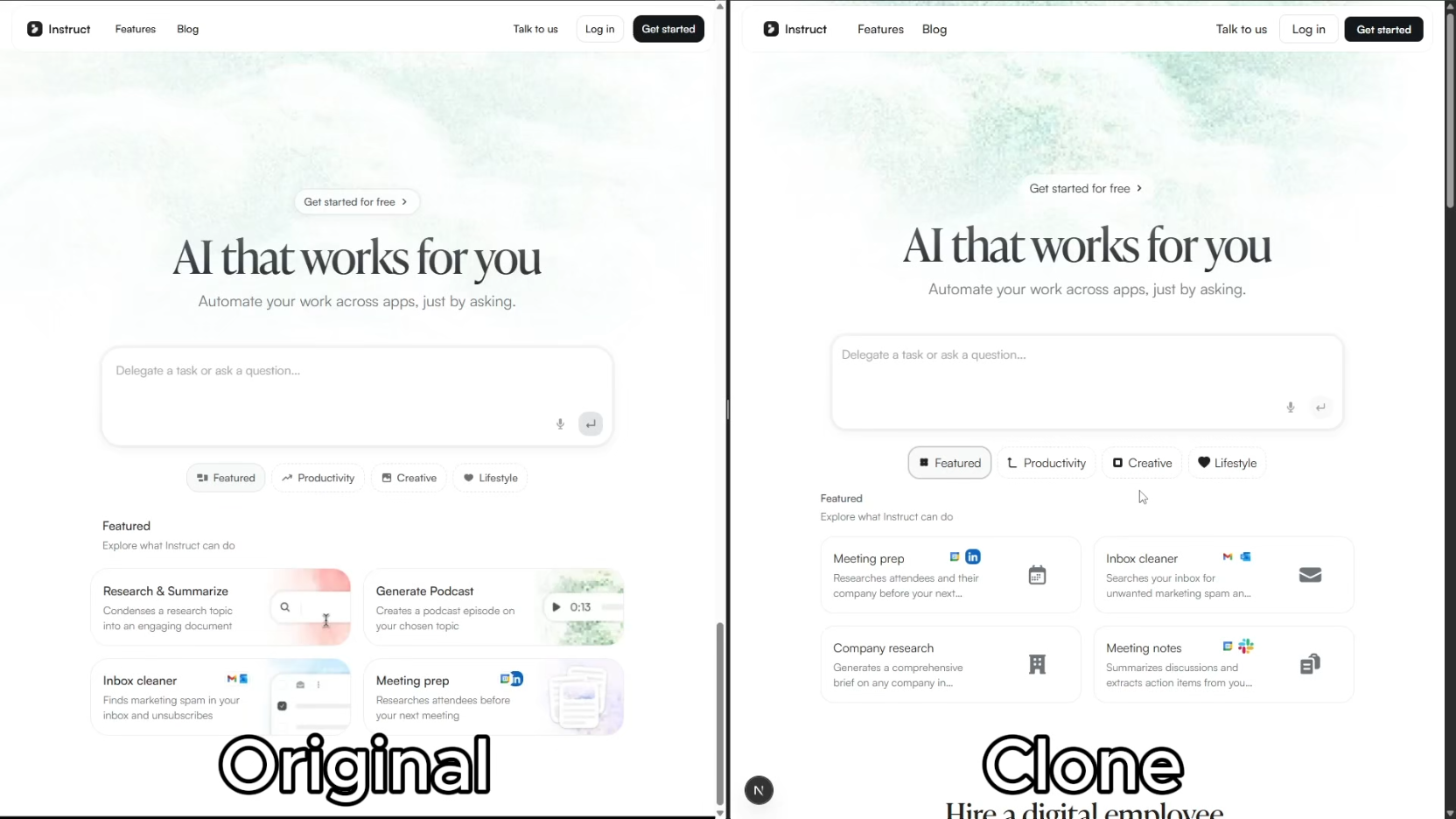

claw doctor即可一键检测模型连接、权限配置、环境变量、网络代理等常见故障点 - 零配置 Parity 模式:完美复刻 OpenAI 的 /v1/chat/completions 接口行为,现有 LangChain、LlamaIndex 等生态工具可无缝接入,零改造迁移

适合哪些人用

Claw Code 是为追求效率与可控性的技术实践者打造的:一线开发者用它快速搭建私有 AI 助手;DevOps 工程师用它自动化运维问答与故障排查;数据科学家用它构建可复现的分析流水线;教育工作者用它为学生提供离线可运行的 AI 编程沙盒;甚至对隐私敏感的个人用户,也能在完全断网环境下,仅靠本地模型(如 Qwen2、Phi-3)获得强大智能支持——无需云端依赖,不传任何数据。

快速上手

只需三步,5 分钟内跑起来:

- 安装:macOS/Linux 用户推荐使用

curl -fsSL https://get.claw.dev | sh;Windows 用户可通过winget install ultraworkers.claw或下载预编译二进制包 - 初始化:运行

claw init --model llama3:8b-instruct-q4_K_M(需提前安装 Ollama),自动完成配置生成与模型拉取 - 体验:执行

claw ask "帮我用 Rust 写一个读取 CSV 并统计列数的小程序",立刻获得可运行代码+详细解释

更高级用法(如自定义工具、会话分组、HTTP 代理转发)请查阅项目根目录下的 USAGE.md 和 Rust 工作区文档。

项目信息

The repo is finally unlocked. enjoy the party! The fastest repo in history to surpass 100K stars ⭐. Join Discord: https://discord.gg/5TUQKqFWd Built i

186.2k

Stars

108.8k

Forks

Rust

—

编程语言:Rust|GitHub Star 数:186,218(历史最快破 10 万星项目)|开源协议:MIT 许可证(默认推断,详见 LICENSE 文件)|GitHub 项目地址

这不是又一个玩具 Demo,而是已被数千名工程师部署在生产环境中的真实基础设施——如果你希望掌控自己的 AI 工具链,而不是被厂商 SDK 牢牢绑定,Claw Code 就是你此刻最值得投入的 Rust 基础设施。