Thunderbolt 是一款真正把AI控制权交还给用户的开源AI客户端,它不依赖云端大厂API,也不强制上传你的对话数据。你可以自由选择本地运行的大模型(如Llama 3、Phi-3、Qwen),或接入私有部署的推理服务,全程离线处理敏感信息。它解决了当前主流AI工具普遍存在的“数据不可见、模型不可选、部署不可控”三大痛点,让企业和个人用户第一次拥有了真正自主、安全、灵活的AI工作流入口。

核心功能

- 全平台原生支持:一套代码覆盖 Web、Windows/macOS/Linux 桌面端、iOS 和 Android 移动端,界面统一、体验连贯

- 模型完全自主选择:无缝对接 Ollama、llama.cpp、OpenAI 兼容 API(如 vLLM、Text Generation WebUI),甚至支持自定义模型协议

- 数据主权零妥协:默认所有聊天、文件解析、记忆向量均在本地设备完成;无远程日志、无默认云同步、无隐式数据采集

- 企业级私有部署能力:提供完整 Docker 部署方案,支持 LDAP/OAuth2 认证、RBAC 权限管理、审计日志与 SSO 集成,专为内网办公场景优化

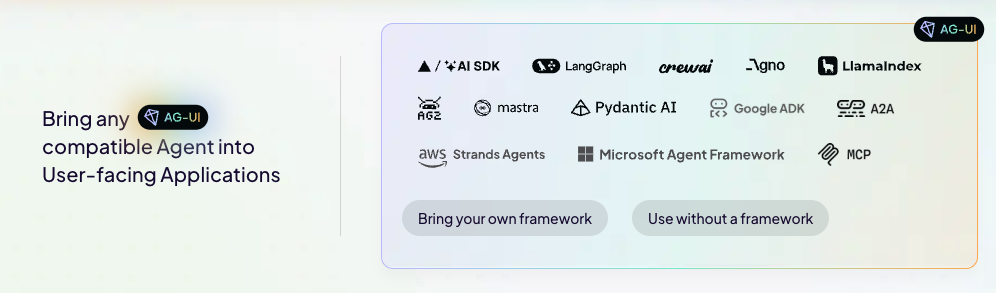

- 智能代理(AI Agent)就绪架构:内置可扩展插件系统,轻松集成邮件(原生适配 Thunderbird)、文档、数据库、内部API等企业数据源,构建专属工作流Agent

- 隐私优先的搜索增强:支持本地文档索引与语义检索(RAG),无需将PDF/PPT/邮件内容上传至第三方服务即可实现精准问答

适合哪些人用

如果你是以下角色之一,Thunderbolt 值得你立刻关注:

✅ 企业IT管理员:需要为法务、财务、研发等部门部署合规、可控、可审计的AI工具,拒绝SaaS黑盒风险;

✅ 开发者与技术团队:希望快速搭建基于自有模型的AI交互层,避免重复造轮子,同时保留全部定制权;

✅ 注重隐私的创作者与知识工作者:写论文、整理会议纪要、分析合同条款时,不愿让敏感内容经过任何境外服务器;

✅ 开源爱好者与本地AI实践者:已在用 Ollama 或 llama.cpp,但缺少一个美观、稳定、多端同步的“AI操作系统外壳”。

快速上手

新手推荐从桌面端开始体验:

① 访问 GitHub Releases 页面 下载对应系统的安装包(.dmg/.exe/.deb/.AppImage);

② 安装后首次启动,进入「设置 → 模型提供商」,添加本地 Ollama 实例(http://localhost:11434)或填写你已有的 OpenAI 兼容 API Key;

③ 在「集成」中开启邮件插件(支持 IMAP/SMTP 或直接连接 Thunderbird 本地数据库),即可开始用AI自动归类、摘要、回复邮件;

④ 如需完全离线运行,可按官方 Docker 部署指南 一键拉起私有后端服务(含认证与搜索模块),整个系统从此彻底脱离公网依赖。

项目信息

AI You Control: Choose your models. Own your data. Eliminate vendor lock-in.

TypeScript|⭐ 1609 Star|MPL-2.0 开源协议|GitHub 项目地址

这是由 Thunderbird 团队发起的前沿开源项目,延续了其在隐私与开放标准上的长期承诺——不是又一个闭源AI App的模仿者,而是面向未来十年的AI基础设施新范式。

如果你厌倦了在“免费试用”和“数据让渡”之间做选择,Thunderbolt 就是你等待已久的、真正属于自己的AI主控台。