NVIDIA NemoClaw 是一个面向自主AI代理(Agent)开发者的开源运行时增强方案,它不是独立的AI模型,而是一套“安全沙箱+智能调度”的参考架构,专为在本地或企业环境中安全、稳定地运行 OpenClaw 这类常驻型AI助手而设计。它通过集成 NVIDIA OpenShell 运行时,显著提升了自主代理的隔离性、权限管控与资源可审计性——解决了当前许多开源Agent项目在生产边缘部署时面临的权限失控、模型调用不可控、日志缺失等核心痛点。

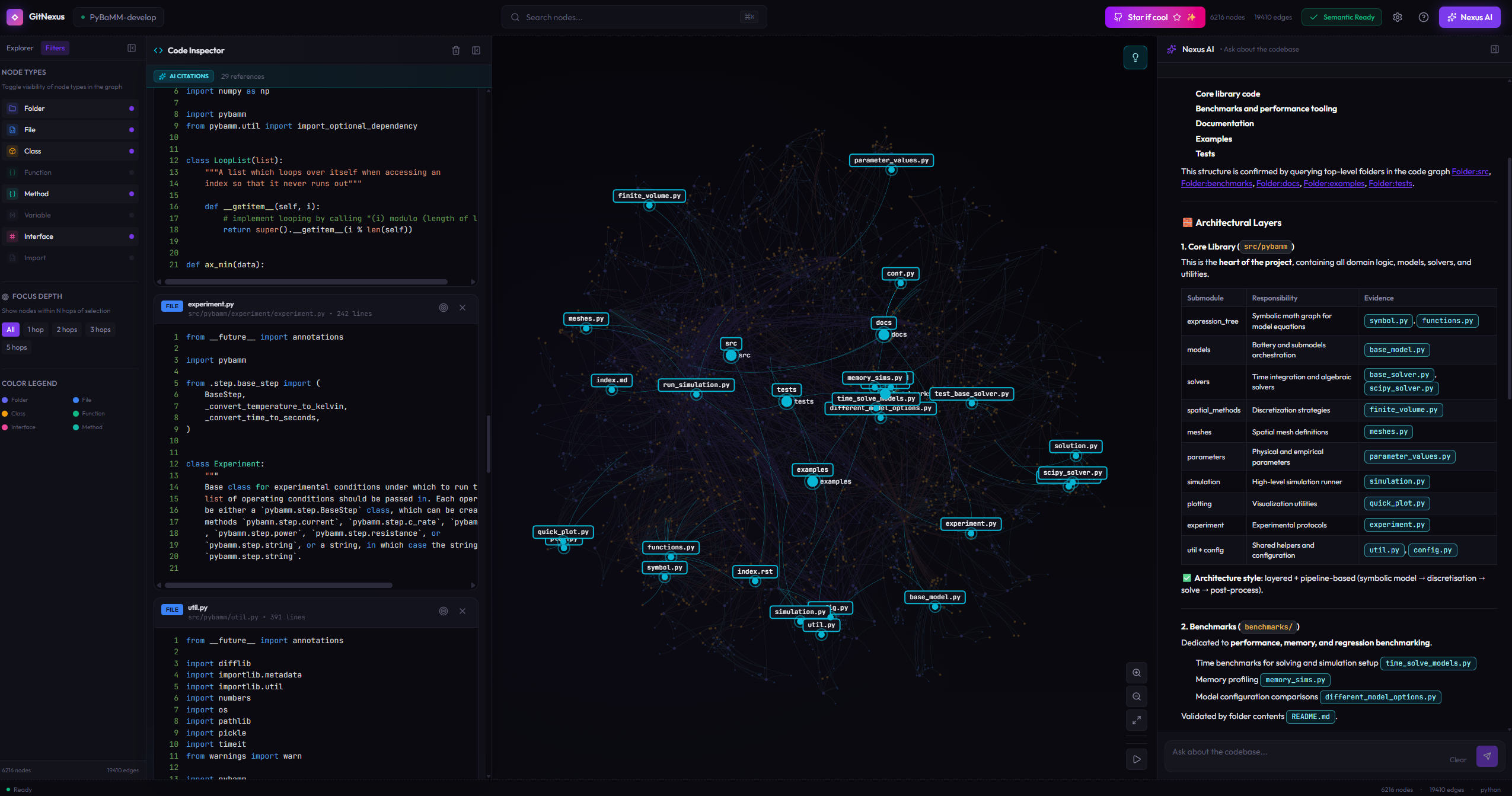

核心功能

- 开箱即用的安全沙箱:自动部署 NVIDIA OpenShell 运行时环境,为 OpenClaw 提供进程级隔离、网络策略限制与文件系统只读挂载,防止恶意或异常指令越权访问主机资源

- 受管推理(Managed Inference)支持:统一拦截并审计所有大模型调用(如 LLM、多模态API),支持速率限制、敏感词过滤、响应重写与审计日志导出,满足企业合规要求

- 轻量级常驻服务模式:内置 systemd 服务模板与 Docker Compose 配置,一键启动 7×24 小时运行的 OpenClaw 助手,支持热重载配置与平滑升级

- 细粒度权限控制中心:提供 CLI 工具与 Web 管理界面(Beta),可按用户/角色分配工具调用权限(如禁止执行 shell 命令、限制访问特定 API 密钥)、设定内存/CPU 使用上限

- 全链路可观测性集成:默认接入 Prometheus + Grafana 监控栈,实时追踪 Agent 响应延迟、Token 消耗、失败率、工具调用分布等关键指标

- 开发者友好扩展接口:基于 TypeScript 构建,提供清晰的插件式架构,支持自定义工具函数、认证中间件、审计钩子与前端主题包,便于二次定制

适合哪些人用

本项目主要面向三类中文技术用户:AI 应用开发者——希望将 OpenClaw 快速落地为可信的企业内部助手(如IT支持机器人、文档智能助理);边缘计算与私有化部署工程师——需要在国产化服务器、Jetson 设备或内网环境中安全运行自主Agent,规避云端依赖风险;高校与研究团队——开展 Agent 安全机制、人机协作范式、可控推理等方向的研究,NemoClaw 提供了可复现、可调试、带完整安全基线的实验平台。普通终端用户暂不建议直接使用,因其定位是基础设施层增强组件,非开箱即用的图形应用。

快速上手

以 Ubuntu 22.04 / 24.04 或 CentOS Stream 9 为例(需已安装 Node.js 20+ 和 Docker):

- 克隆项目:

git clone https://github.com/NVIDIA/NemoClaw.git && cd NemoClaw - 安装依赖并构建:

npm ci && npm run build - 启动安全运行时(含 OpenClaw 示例):

npm run start:shell(首次运行会自动拉取 OpenShell 镜像并初始化沙箱) - 访问

http://localhost:3000即可进入管理控制台,查看运行状态、配置工具权限、查看审计日志 - 如需对接自有 OpenClaw 实例,只需修改

config/openclaw.yaml中的 endpoint 和 token 即可无缝接入

详细指南请参阅项目 官方文档目录,中文社区也在持续翻译补充常见部署场景(如国产麒麟OS适配、飞腾CPU兼容方案)。

项目信息

Run OpenClaw more securely inside NVIDIA OpenShell with managed inference

19.2k

Stars

2.4k

Forks

TypeScript

Apache-2.0

编程语言:TypeScript|GitHub Star 数:19,188|开源协议:Apache-2.0|GitHub 项目地址

如果你正在构建需要长期稳定运行、具备企业级安全水位的AI助手,NemoClaw 正是那个帮你把「能力」和「可控性」真正统一起来的关键拼图。