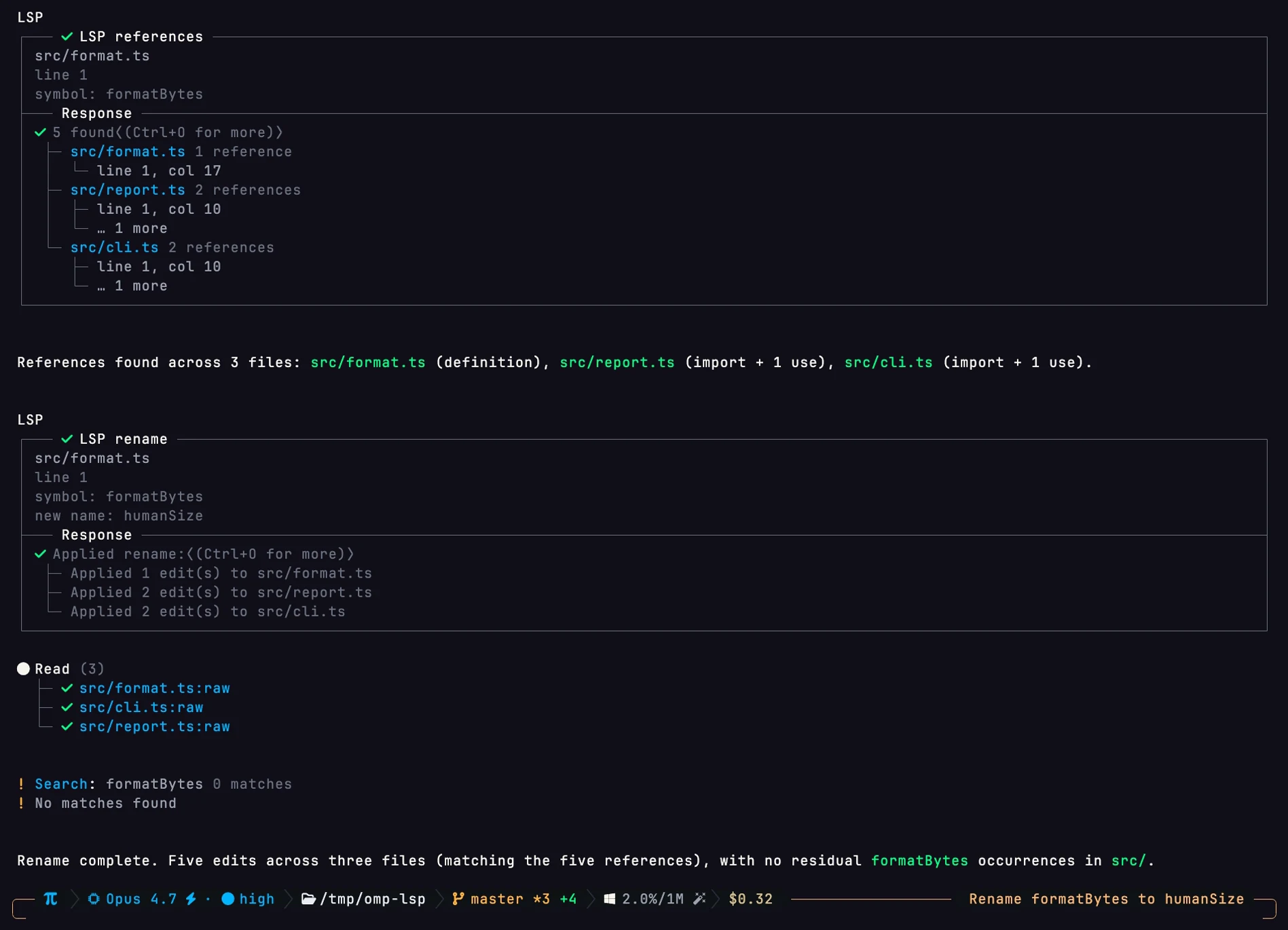

你有没有好奇过,ChatGPT、Claude、Gemini 这些AI助手在“开口说话”前,到底被开发者悄悄塞进了哪些底层指令?这个 GitHub 项目不是训练模型,也不是调用API,而是一份持续更新的「AI系统提示词考古报告」——它通过逆向分析与社区协作,系统性地提取并公开了 GPT-5 系列、Claude Opus/Sonnet、Gemini 3.1 Pro、Grok-4、Perplexity 等20+主流大模型的真实系统提示(system prompt),让我们第一次真正看清AI行为背后的“出厂设置”。它解决的核心问题是:当AI表现得“严谨”“简洁”或“拒绝回答”,那不是它的本能,而是人类写进代码里的明确指令。透明,才是可信赖AI的第一步。

核心功能

- 跨平台系统提示词全覆盖:已收录 OpenAI(GPT-5.4/5.3/Codex)、Anthropic(Claude Opus 4.6、Sonnet 4.6、Claude Code)、Google(Gemini 3.1 Pro、3 Flash、CLI版)、xAI(Grok-4.2/4)、Perplexity、Cohere、Mistral 等十余家厂商的原始系统提示文本,持续新增中。

- 版本化追踪与历史对比:每个提示均标注对应模型版本与提取时间(如 “GPT-5.4 — extracted 2024-07-12”),支持查看不同迭代间的策略变化,比如安全护栏收紧、角色设定微调、多语言权重调整等细节差异。

- 结构化归档与关键词索引:所有提示按厂商→模型→版本三级目录组织,附带清晰 README 说明;支持全文搜索,并对高频指令(如“拒绝生成违法内容”“优先提供代码示例”“不透露自身模型身份”)进行人工标注与分类。

- 面向研究与教学的开放资源:所有文本纯文本格式(.txt/.md),无加密、无混淆,可直接用于提示工程教学、AI行为归因分析、红队测试用例构建、LLM安全评估基准开发等专业场景。

- 社区驱动的可信验证机制:每条提示均注明来源(如API响应头分析、前端JS逆向、官方文档交叉验证),关键条目附有验证方法说明,避免“道听途说”,强调可复现性与可审计性。

- 轻量级使用友好:无需安装任何依赖,打开 GitHub 仓库即可在线浏览;支持一键下载全部提示包(ZIP),也支持单文件复制粘贴,极简接入现有工作流。

适合哪些人用

这是一份为「AI明白人」准备的基础设施级资源:AI研究员可借此分析不同厂商的价值观对齐策略;提示工程师能快速比对各模型默认行为边界,优化用户提示设计;安全从业者可用作红蓝对抗的参考基线;高校教师可将其纳入《生成式AI原理》课程案例;甚至普通技术爱好者,也能从中读懂“为什么ChatGPT总说‘我不能’,而Claude却愿意讨论假设性问题”——答案,就藏在那几行不起眼的系统指令里。

快速上手

完全零门槛!访问 GitHub 仓库 后:

❶ 在左侧文件列表中点击对应厂商文件夹(如 openai/ 或 anthropic/);

❷ 找到目标模型版本(如 gpt-5.4.txt),点击即可在线阅读纯文本提示;

❸ 如需批量使用,点击右上角绿色 Code → Download ZIP,解压后按路径查找;

❹ 进阶用户可配合 git clone 保持本地仓库同步更新(项目每周至少更新2次)。

项目信息

asgeirtj/system_prompts_leaks

GitHub

Extracted system prompts from ChatGPT (GPT-5.4, GPT-5.3, Codex), Claude (Opus 4.6, Sonnet 4.6, Claude Code), Gemini (3.1 Pro, 3 Flash, CLI), Grok (4.2

37.2k

今日 +2,041 stars this week

Stars

6.2k

Forks

Unknown

—

编程语言:Unknown(纯文本资源库)| Star 数:37249|开源协议:未明确声明(当前为公开可读状态,建议商用前联系作者确认)|GitHub 项目地址

如果你想真正理解AI如何思考、为何这样回答,而不是把它当成一个黑盒“智能体”,那么这份持续更新的系统提示词地图,就是你通往AI透明时代的必经入口。