你是否想过,在没有 GPU 服务器、不依赖云端 API 的情况下,直接用自家 M1/M2/M3 Mac 运行能“看图说话”的 AI 模型?MLX-VLM 正是为此而生——它是一个专为 Apple Silicon 优化的开源工具包,让你在本地 Mac 上轻松完成多模态大模型(VLM)的推理与微调。无论是分析截图、解读 PDF 表格、理解产品照片,还是开发自己的图文对话应用,它都提供了开箱即用的支持,真正把强大的视觉语言能力装进你的笔记本电脑里。

核心功能

- 全本地多模态推理:无需联网、不传数据,支持 LLaVA、Idefics、Pixtral、Florence-2、PaliGemma、MoLMo、DeepSeek-OCR 等十余种主流 VLM,在 M 系列芯片上流畅运行

- 一键式交互体验:内置 Gradio 图形化聊天界面,拖入图片+输入问题即可实时对话,支持多图连续提问(如对比两张发票、分析流程图+说明书)

- 高效显存管理技术:集成 Vision Feature 缓存、TurboQuant KV 缓存等 MLX 原生优化,显著降低内存占用,让 16GB 内存的 MacBook Air 也能跑起 7B 参数模型

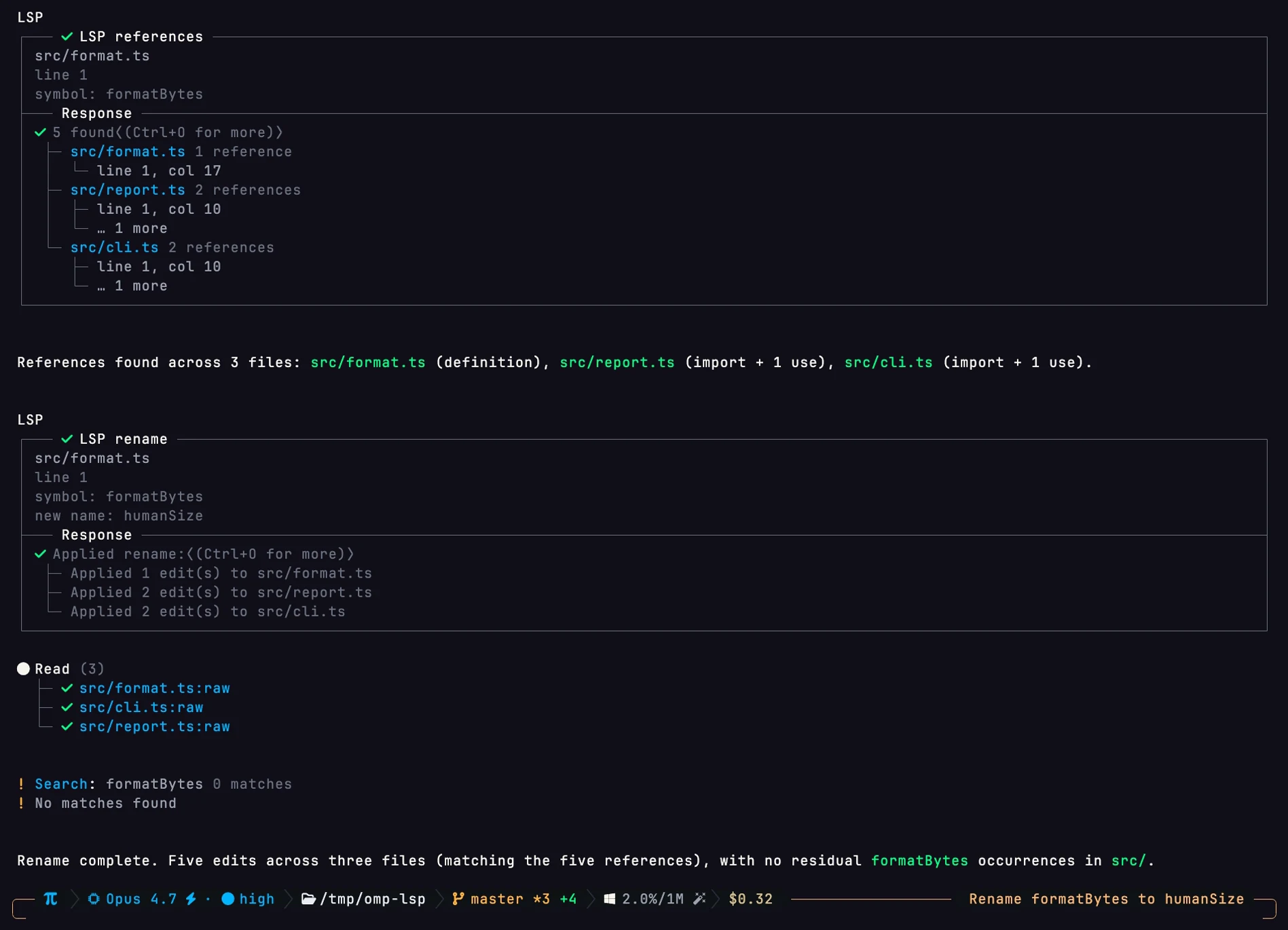

- 灵活部署方式:既可通过命令行快速测试(

mlx-vlm chat --model llava),也支持 Python 脚本集成到自有项目中,还提供细粒度 API 控制推理过程 - 生产级微调支持:内置 LoRA 微调框架,支持自定义数据集对模型进行轻量适配(例如让模型专注识别医疗报告或工业图纸)

- 模型即插即用生态:每个主流模型均有独立文档,明确标注 prompt 格式、图像预处理要求和最佳实践(如 DeepSeek-OCR-2 对扫描件的特殊增强建议)

适合哪些人用

这款工具特别适合三类用户:AI 开发者——想在本地快速验证多模态方案、调试 prompt 工程或构建私有图文分析服务;科研教育者——用于教学演示、学生实验或论文复现实验,完全离线、可审计、零成本;注重隐私的专业用户——设计师、医生、法务、财务等需要处理敏感图像资料的人群,再也不用把截图上传到第三方平台。

快速上手

只需三步,5 分钟内启动第一个图文对话:

- 确保已安装 Python 3.9+ 和 MLX(推荐使用

pip install mlx) - 执行安装命令:

pip install mlx-vlm - 启动交互式聊天界面:

mlx-vlm chat --model llava-hf(自动下载并加载模型),然后在浏览器中打开 http://localhost:7860 即可开始拖图提问

进阶用户还可通过 CLI 指定量化精度(如 --quantize q4)、启用多图模式(--multi-image)或加载本地模型路径,所有参数均有清晰帮助文档(mlx-vlm --help)。

项目信息

MLX-VLM is a package for inference and fine-tuning of Vision Language Models (VLMs) on your Mac using MLX.

3.5k

今日 +316 stars today

Stars

386

Forks

Python

MIT

编程语言:Python|GitHub Star 数:3493|开源协议:MIT|GitHub 项目地址

如果你有一台 Mac,又想真正掌控自己的多模态 AI 能力——不被算力卡脖子,不向云端交出隐私,不被 API 配额限制,那 MLX-VLM 就是你此刻最值得尝试的开源利器。