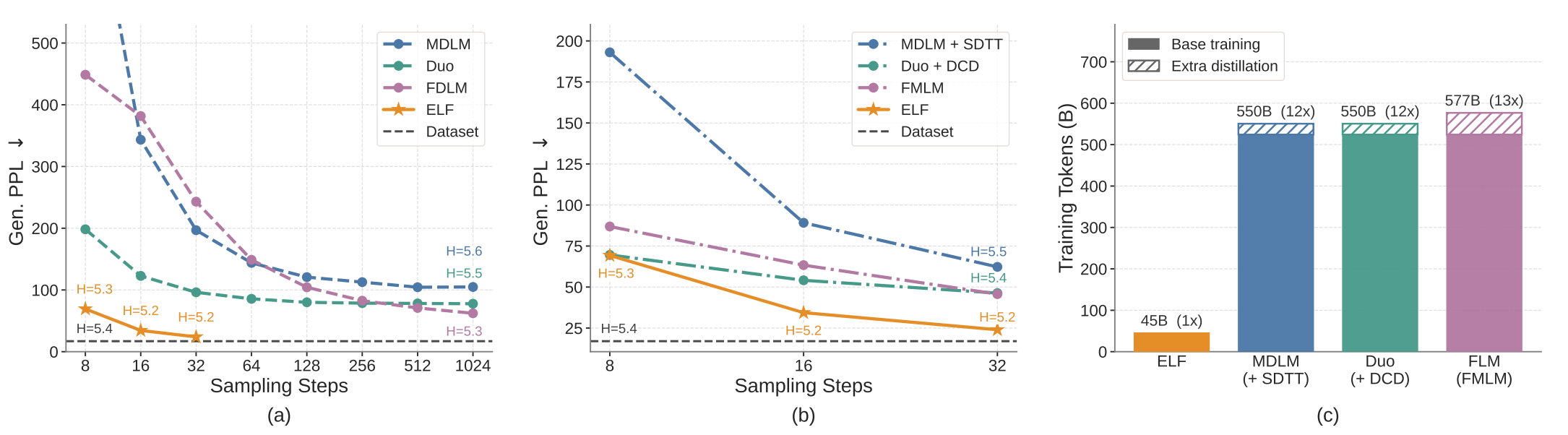

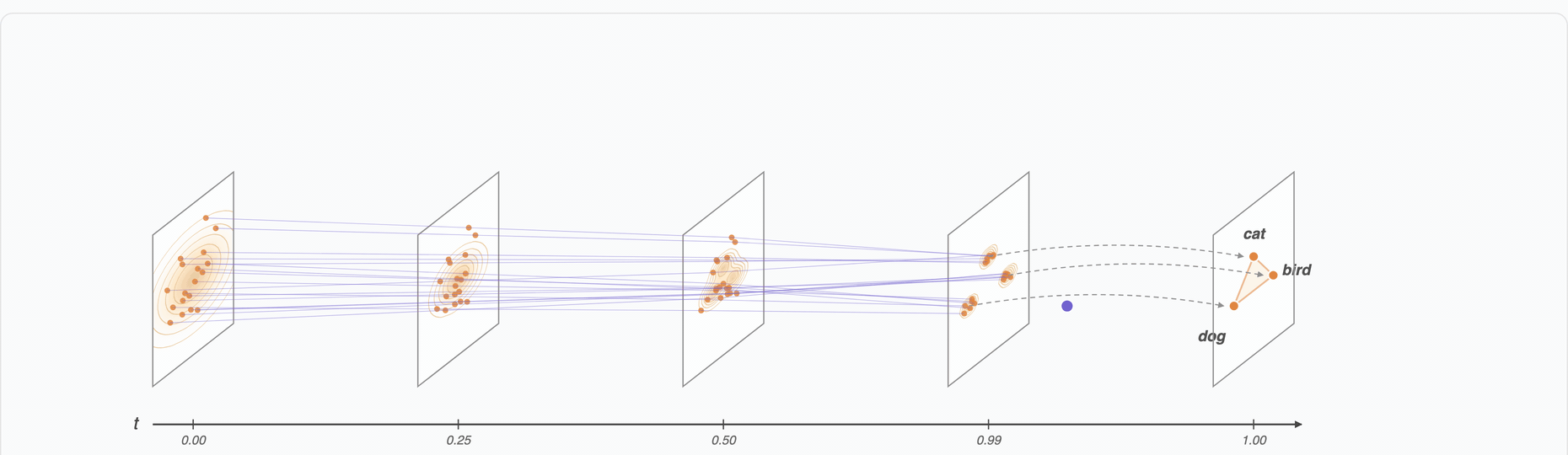

ELF(Embedded Language Flows)不是另一个微调工具,而是一次对语言生成底层范式的重新思考:它把文本生成从“离散token跳跃”变成“连续语义流动”。传统大模型逐词预测,容易卡顿、重复或逻辑断裂;ELF则在词向量(embedding)的连续空间中模拟物理般的“去噪轨迹”,像水流一样自然地从噪声演化出语义清晰的句子,最后一步才映射为可读文字。它解决了扩散式语言建模长期存在的训练不稳定、采样效率低、难以复用图像领域成熟技巧(如无分类器引导)等核心痛点。

核心功能

- 全嵌入空间连续扩散:全程在高维语义向量空间中进行Flow Matching建模,避免早期离散化带来的梯度断裂与信息损失

- 即插即用的无分类器引导(CFG):得益于连续空间建模,可直接复用Stable Diffusion等图像模型中成熟的CFG技术,实现更可控、更高质量的文本生成

- 共享权重离散化头:仅在最终时间步(t=1)通过一个轻量、参数共享的网络将连续嵌入映射为token,大幅降低解码开销,提升推理一致性

- TPU原生优化设计:官方JAX实现深度适配Google TPU集群,支持超长序列并行训练与高效批处理,适合大规模实验

- 模块化架构,易于扩展:核心Flow Matching框架解耦了嵌入编码器、流匹配器与离散化器,方便研究者替换LLM底座(如Llama、Phi)或引入新引导策略

- Hugging Face一键体验:已上线Hugging Face Spaces演示页,无需本地环境即可直观感受“语义流动”生成过程

适合哪些人用

ELF主要面向三类中文技术用户:一是AI算法研究员,尤其关注扩散语言模型(DLM)、生成式基础模型理论创新的研究者,可基于其开源代码快速验证Flow Matching在NLP中的新变体;二是大模型工程师,需要构建高可控性、低幻觉生成系统的团队,ELF提供的CFG支持与稳定采样特性可直接用于对话、摘要等下游任务增强;三是高校师生与进阶学习者,项目结构清晰、文档完整(含arXiv论文+可视化GIF),是理解“连续语言建模”前沿思想的优质教学案例——比纯理论更落地,比黑盒API更透明。

快速上手

安装仅需两步(推荐Python 3.10+ & JAX with TPU/ CUDA支持):

pip install git+https://github.com/lillian039/ELF.git # 或克隆后安装 git clone https://github.com/lillian039/ELF.git && cd ELF && pip install -e .

运行示例生成(自动下载预训练ELF-B模型):

python examples/generate.py --prompt "春天的西湖像一幅水墨画" --num_samples 2 --cfg_scale 4.0

想跳过命令行?直接访问 Hugging Face演示页,输入中文提示词,实时观看嵌入空间中的“语义粒子”如何沿轨迹汇聚成文——每帧动画都是模型内部连续演化的忠实呈现。

项目信息

573

Stars

34

Forks

Python

MIT

编程语言:Python(JAX)|GitHub Star 数:573|开源协议:MIT|GitHub 项目地址

如果你厌倦了“下一个词预测”的机械感,渴望真正理解语言生成的动态本质——ELF不是又一个黑盒API,而是一扇通往连续语义世界的透明窗口。